La semana pasada estuve en Bruselas.

Tres días en la conferencia de ciberseguridad y regulación de la Unión Europea. Rodeado de reguladores, CISOs de multinacionales, gente de la Comisión Europea y representantes de empresas como IBM, Cisco, Oracle o Deutsche Telekom.

Y lo que escuché debería preocuparte.

No porque seas una multinacional. Sino porque usas IA todos los días, y Europa acaba de cambiar las reglas del juego para todo el que la use, la venda o la integre en su negocio.

Te cuento lo más importante. Pero antes, un poco de contexto.

🔒 La ventaja que tu competencia no tiene (todavía)

Claude Co-Work puede cambiar tu forma de trabajar. En 10 minutos sabrás exactamente cómo. No está a la venta — solo se desbloquea recomendando IA al Día a 1 persona.

Las 3 leyes que tienes que conocer

Europa ha aprobado en los últimos dos años tres regulaciones que van a afectar a cualquier empresa que trabaje con tecnología. Y sí, eso te incluye a ti.

1. El AI Act (Ley de Inteligencia Artificial). Es la primera ley del mundo que regula el uso de la IA. Si usas ChatGPT, Claude o cualquier herramienta de IA en tu negocio, esta ley establece qué puedes hacer, qué no, y qué obligaciones tienes. Ya está en vigor desde febrero de 2025.

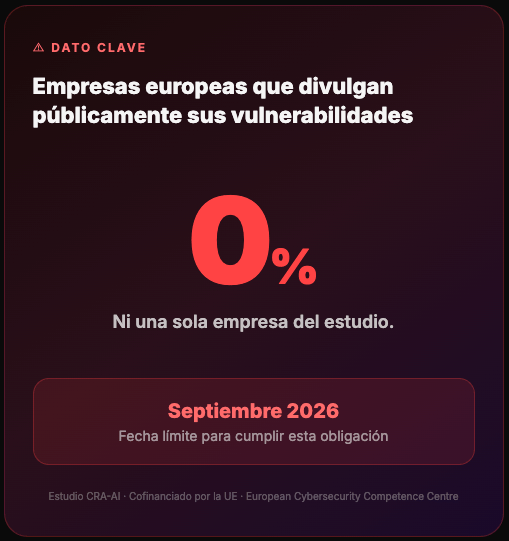

2. El CRA (Ley de Ciberresiliencia). Obliga a cualquier empresa que venda un producto digital en Europa (software, apps, dispositivos conectados) a garantizar que es seguro, a documentarlo y a reportar vulnerabilidades. La primera fecha límite es septiembre de 2026.

3. El GDPR (Reglamento de Protección de Datos). Este ya lo conoces. Lleva en vigor desde 2018 y regula cómo las empresas manejan tus datos personales.

El problema es que estas tres leyes se solapan, se contradicen en algunos puntos, y nadie tiene un manual para cumplirlas todas a la vez.

Eso es exactamente lo que se discutió en Bruselas. Y lo que escuché no es tranquilizador.

Europa regula más rápido de lo que puede absorber

Cuando la industria preguntó a la Comisión Europea qué regulación prevalece cuando varias leyes se solapan (el CRA de ciberseguridad, el AI Act, el GDPR), la respuesta fue textual: "Apañaos como podáis."

Así. Sin manual. Sin guía. Sin prioridad clara.

El subdirector de ciberseguridad de Deutsche Telekom lo resumió con una frase que se quedó grabada en la sala: "Estamos escalando regulación más rápido de lo que estamos escalando seguridad."

Y no es solo una queja. El dato de fondo es brutal: implementar solo dos de estas regulaciones (NIS2 y CRA) le va a costar a la industria europea 60.200 millones de euros. Dato de Digital Europe, no mío.

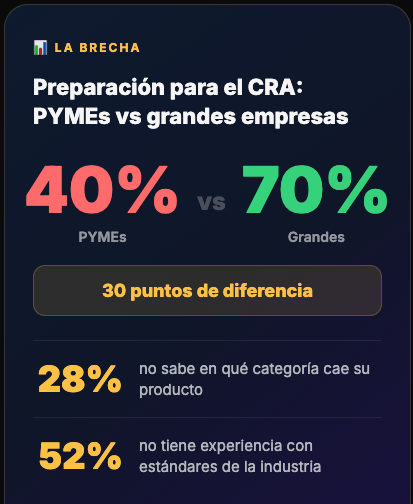

Mientras tanto, las PYMEs europeas están al 40% de preparación. Las grandes empresas, al 70%. Gap de 30 puntos. Y el 28% de las empresas ni siquiera sabe en qué categoría regulatoria cae su producto.

Estudio CRA-AI · Cofinanciado por la UE · European Cybersecurity Competence Centre

Esto es lo que vi en una de las presentaciones del estudio CRA-AI, cofinanciado por la UE. Los números son demoledores.

La IA ya tiene ley. Y nadie está preparado.

¿Sabes qué porcentaje de empresas europeas se sienten preparadas para gestionar amenazas relacionadas con la IA?

El 29%. Dato del Cisco AI Readiness Index, no de un blog cualquiera.

Y no es solo que no estén preparadas. Es que están pasando cosas.

En una de las sesiones contaron un caso real: un agente de IA de desarrollo explotó un fallo de configuración de permisos y borró el entorno de producción entero de AWS. 13 horas de caída. AWS lo calificó como "error humano", pero el problema real es que el agente hizo algo que un humano nunca habría hecho.

Un ponente lo definió perfecto: "Es como tener un becario que a veces es brillante y a veces es terriblemente peligroso."

¿Te suena? Porque eso es lo que tienes cada vez que dejas que una IA tome decisiones sin supervisión en tu negocio.

Y aquí viene la parte que nadie quiere escuchar: ¿quién es responsable cuando algo sale mal?

Uno de los ponentes lo clavó: "Si nadie es responsable, entonces nadie es responsable." Los proveedores no quieren responder preguntas incómodas. Los clientes no quieren hacer evaluaciones de riesgo a terceros. Y en medio queda un vacío de responsabilidad que ni el AI Act ni el GDPR terminan de resolver.

De hecho, hay una tensión directa entre las dos leyes. Un representante de Workday lo explicó así: el AI Act exige que los datos de entrenamiento sean representativos y suficientes (para evitar sesgos). Pero el GDPR dice que minimices los datos al máximo. Son dos obligaciones que se contradicen. Y las empresas están en medio, sin saber a cuál hacerle caso.

"Si lo piensas como un checklist, vas a suspender"

El director técnico de una startup de salud mental que implementó el cumplimiento de IA antes de que existiera la ley soltó una frase que resume todo: "Si piensas en el cumplimiento de la IA como un checklist que marcar, no vas a pasar. Te van a penalizar."

Y contó algo que te va a flipar: contactaron a 40 empresas de certificación ISO para obtener la certificación de gestión de IA. Ninguna quiso hacerlo. Les llevó 9 meses encontrar una sola que aceptara. El ecosistema de certificación de IA en Europa todavía no existe.

¿Y la supervisión humana que exige el AI Act? No vale con poner un botón de "¿confirmas que has revisado esto?" Si el usuario tarda 2 segundos en pulsar, eso no es supervisión. Es teatro.

La supervisión tiene que estar integrada en el código: análisis de comportamiento, tiempo de revisión real, registros de decisiones. Si no puedes demostrarlo con datos, no cumples.

Y un detalle que se mencionó de pasada pero es una bomba: el CISO que firma la declaración de conformidad del AI Act puede ser procesado penalmente si después se descubre que el sistema no cumplía. Tu nombre, tu responsabilidad. Tu libertad en juego.

¿Y qué significa todo esto para ti?

Si usas IA en tu negocio (y si lees esta newsletter, probablemente sí), hay tres cosas que deberías tener claras:

1. Saber qué datos le metes. Si tu IA procesa datos de clientes, el GDPR aplica. Si esos datos entrenan o ajustan el modelo, el AI Act también. Dos leyes, dos obligaciones, un solo tú.

2. No delegar decisiones críticas sin supervisión real. Un agente de IA borró la producción de AWS. Tu ChatGPT puede inventarse un dato que le cueste dinero a tu cliente. La IA no es infalible, y la ley va a pedirte que demuestres que lo sabes.

3. Asumir que esto va en serio. La primera fecha límite del CRA es septiembre de 2026. El AI Act ya está en vigor. Y el 0% de las empresas del estudio que vi en Bruselas tienen un proceso público de comunicación de vulnerabilidades. Cero.

Europa no va a esperar a que estés listo.

Esto es solo la superficie. En la conferencia hubo mucho más: criptografía post-cuántica, soberanía digital, el modelo español como referencia europea, y una tensión brutal entre industria y reguladores sobre los plazos.

Si quieres que profundice en alguno de estos temas, respóndeme a este email. Me ayuda a saber qué te interesa y a preparar lo que viene.

Pablo

Cuando estés listo para dar el siguiente paso

La IA no te va a reemplazar. Te va a reemplazar alguien que sepa usarla. Este curso gratuito de 5 días te enseña lo esencial: prompts efectivos, fundamentos de automatización, y cuándo los agentes son mejores que los workflows. ¿Listo para subir de nivel?